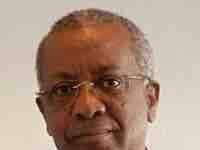

Alors qu’Elon Musk dévoile Grokipedia, une encyclopédie «vérifiée par l’IA» censée libérer la vérité des biais humains, les experts s’inquiètent d’une dérive idéologique masquée sous couvert de neutralité. Pour Félix Balmonet, CEO de Chat3D, le projet flirte dangereusement avec le fantasme d’un «ministère de la Vérité» version Silicon Valley.

Elon Musk présente Grokipedia comme une encyclopédie «vérifiée par l’IA». Derrière cette promesse de fiabilité, qui contrôle concrètement ce que cette intelligence artificielle considère comme vrai ?

En réalité, personne. Ce qu’il faut comprendre, c’est que Musk s’intéresse depuis quelque temps déjà à la notion de «vérité» – ou plutôt à sa vision très libertarienne de la liberté d’expression. Il a toujours mal vécu la censure de Donald Trump sur les réseaux sociaux, et il avait déjà lancé plusieurs piques contre Wikipedia. Il y a environ un an, il avait même déclaré publiquement qu’il donnerait un milliard de dollars à la fondation Wikipedia si elle acceptait de s’appeler… Dickipedia (je vous laisse la traduction). C’est dire à quel point cette idée de créer une alternative «libérée» de la censure trotte dans sa tête depuis longtemps. Ce qui dérange Musk dans Wikipedia, c’est que tout le monde puisse y contribuer librement. Il estime que le site est devenu trop influencé par ce qu’il appelle des idées woke. Grokipedia s’inscrit donc dans cette logique : un système où les articles sont générés par l’IA de xAI, sa propre entreprise, sans véritable contrôle humain ni transparence. Et quand la base d’entraînement de cette IA, c’est X (ex-Twitter) – un espace saturé d’opinions et de désinformation -, le résultat ne peut qu’être biaisé. Si vous cuisinez avec de mauvais ingrédients, vous n’obtenez pas un bon gâteau.

En quoi Grokipedia diffère-t-elle fondamentalement de Wikipedia ?

Wikipedia repose sur un processus quasi scientifique : un travail collaboratif, une validation par les pairs, des corrections successives… Vous ne pouvez pas modifier un article sans qu’il soit soumis à la communauté, débattu, puis validé. Grokipedia fait tout l’inverse. Il n’y a ni communauté, ni vérification, ni relecture. Les textes générés par l’IA sont pris pour argent comptant, comme une vérité absolue. C’est la négation même du processus de correction et d’enrichissement collectif.

Comment Elon Musk conçoit-il la «neutralité» de son IA ?

Pour saisir ce que Musk entend par «neutralité», il faut d’abord comprendre comment une IA de génération de texte est construite. Chez OpenAI, par exemple, il existe deux étapes : le training, où le modèle apprend à partir de données, puis le post-training, où une autre équipe introduit des garde-fous – des limitations destinées à éviter que l’IA dise n’importe quoi. La démarche de Musk, c’est précisément de supprimer ces garde-fous. Il dit vouloir éliminer la censure politique, mais dans les faits, cela revient à créer une IA sans filtre. Ce qu’il présente comme une neutralité est en réalité une orientation idéologique assumée : un modèle calibré pour ne pas être “woke”, donc très à droite, très libertarien, dans la droite ligne de sa propre vision du monde.

Grokipedia libère-t-elle l’information, ou la verrouille-t-elle sous un nouveau prisme idéologique ?

Clairement, elle la verrouille. On est face à un instrument de communication qui prétend incarner la vérité, mais qui véhicule une idéologie bien précise. C’est de la politisation de l’intelligence artificielle. Musk veut faire passer un générateur de contenu pour un arbitre du vrai. Mais derrière la promesse technologique, on retrouve une vérité très orientée, façonnée par un logiciel entraîné sur un corpus biaisé.

En pratique, quelles technologies Grokipedia utilise-t-elle pour valider ses données ? Peut-on parler d’encyclopédie scientifique ou d’agrégateur idéologique automatisé ?

C’est tout sauf un processus scientifique. Grokipedia n’est pas une encyclopédie, c’est un agrégateur automatique de contenus – vrais ou faux, peu importe. Aujourd’hui, la plupart des systèmes d’IA performants fonctionnent sur un double modèle : un générateur et un vérificateur. L’un produit du texte, l’autre vérifie sa cohérence et sa véracité. Or, sur Grokipedia, cette deuxième étape est quasi inexistante. La vérification des faits est très faible, pour ne pas dire inexistante. C’est là que réside le danger.

Si une IA devient arbitre du vrai et du faux, quelles sont les implications éthiques et démocratiques d’un tel modèle ?

Elles sont considérables – et inquiétantes. Quand une IA se présente comme détentrice de la vérité, c’est le même danger que lorsqu’un individu prétend l’être. Sauf qu’ici, le risque est décuplé, car une machine inspire une confiance aveugle. Quand un humain prétend détenir la vérité, on parle de religion, de dogme, ou d’idéologie. Quand c’est un programme informatique, beaucoup y voient une forme d’objectivité. Et c’est ce qui rend Grokipedia dangereux. Le plus paradoxal, c’est que les gens savent que ce n’est pas fiable, mais continuent d’y croire, un peu comme avec ChatGPT : la technologie n’est pas conçue pour donner l’information, mais pour produire du texte. Il y a un immense enjeu d’éducation numérique pour faire comprendre que l’IA n’est pas la vérité.

Et où en est le projet Grokipedia aujourd’hui ?

Il y a eu un premier lancement, mais il semble avoir été partiellement suspendu. Notamment après un incident en France : une page consacrée à une mosquée avait été remplie de propos racistes et xénophobes. Peut-être qu’en France, le projet est en pause, mais il continue d’exister aux États-Unis. Ce n’est pas très glorieux… et franchement, oui, c’est inquiétant. On est presque dans une logique orwellienne. Dans 1984, il y a le «ministère de la Vérité» – une institution chargée de décider de ce qui est vrai et de ce qui ne l’est pas. Grokipedia, c’est un peu ça : une IA qui prétend détenir la vérité absolue. Et ça, c’est sans doute la dérive la plus dangereuse de notre époque.